Az FBI a napokban kiadott közleményében arra az ijesztő és egyre inkább terjedő trendre figyelmeztetett, hogy bűnözők deepfake videókat használnak zsarolás céljára.

Az FBI kijelentette, hogy a bűnözők módosítják az egyénekről készült fényképeket vagy videókat, és nyílt tartalommá alakítják azokat, hogy így zaklassák áldozataikat.

Ehhez mesterséges intelligencia hajtotta tartalom manipulációs technológiákat és szolgáltatásokat használnak. Az egyén közösségi média fiókjából vagy az internetről töltenek le fényképeket, amelyeket később szexuális témájú, élethűnek tűnő képekké alakítják.

A manipulált anyagot ezután a közösségi médiában, nyilvános fórumokon vagy pornográf webhelyeken terjesztik.

Sok áldozat, köztük kiskorúak is, nem tudnak arról, hogy képeiket lemásolták, amíg valaki más fel nem hívja rá a figyelmet.

„Az FBI továbbra is kap jelentéseket áldozatokról, köztük kiskorú gyermekekről és… felnőttekről, akiknek fényképeit vagy videóit nyílt tartalommá alakították át” – mondta az ügynökség egyik szóvivője.

2022-ben a bűnüldöző szervekhez több mint 7000 bejelentés érkezett kiskorúakat célzó online zsarolásról.

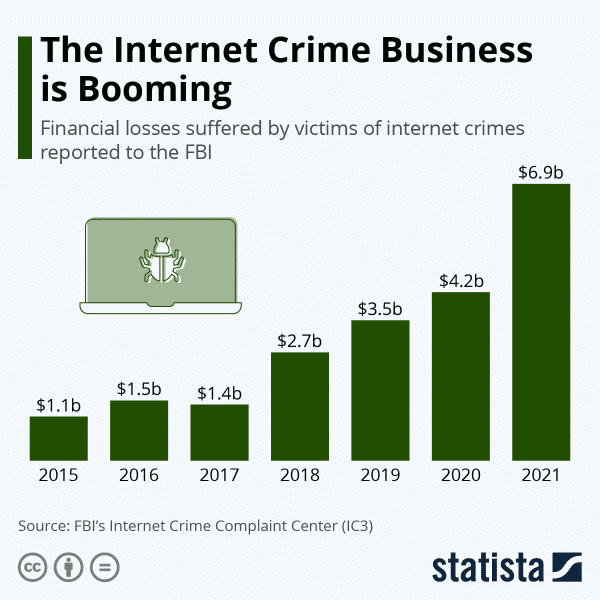

Forrás: Statista

A deepfakek egyre elterjedtebbek az AI-nak köszönhetően

A mesterséges intelligencia térnyerésével a deepfake-ek is egyre inkább elterjednek.

Az olyan generatív mesterséges intelligencia platformok, mint a Midjourney 5.1 és az OpenAI-féle DALL-E 2, rendkívül megkönnyítik a zsarolók dolgát.

Májusban a Tesla és a Twitter vezérigazgatója, Elon Musk képét használták fel deepfake tartalomhoz, hogy átverjenek mit sem sejtő kripto befektetőket.

A közösségi médiában megosztott videó Musk korábbi interjúiból készült felvételeket tartalmazott, amelyeket a csalók kényük kedvükre manipuláltak.

🇺🇸🇨🇳BREAKING: Leaked internal audio from Chinese Foreign Minister Qin Gang on US-China relations, discussing the reasons behind tense relations and the inevitability of war (Thread) 🧵

The 10 minute recording contains many powerful insights from the head of China’s foreign… pic.twitter.com/Ofs6RWqT4g

— Hanna (@VirtuHanna) June 4, 2023

Azonban nem minden manipulált videót használnak fel ilyen célra. Egy nemrégiben a Ferenc pápáról készítettek videóban a pápa egy fehér Balenciaga kabátot viselt. A videót szórakoztatás céljából terjesztették el online.

Az FBI ajánlásai a deepfake elleni küzdelemhez

Az FBI azt javasolta a szülőknek, hogy kövessék figyelemmel gyermekeik online tevékenységeit. Arra kérik a szülőket, hogy beszéljék meg a személyes tartalmak megosztásával kapcsolatos kockázatokat gyermekeikkel és alkalmazzanak diszkréciót képek, videók és személyes tartalmak online közzétételekor.

Ezenkívül azt is javasolják, hogy az egyének keressenek magukra és gyermekeikre online, hogy segítsenek azonosítani a személyes adatok interneten való megjelenését és terjedését.

A szervezet szorgalmazza a közösségi média oldalak által biztosított adatvédelmi beállítások használatát, hogy a felhasználók korlátozzák fotóikak, videóikat és egyéb személyes adataik nyilvános megjelenését.

Az FBI felszólította a lakosságot, hogy legyenek óvatosak, amikor személyes fényképeket, videókat és azonosítási információkat tesznek közzé vagy küldenek el közvetlenül a közösségi média oldalakon. Ezek a tartalmak bőséges anyagot biztosíthatnak a rosszindulatú szereplőknek, amelyeket bűnözői célokra használhatják fel azokat.

A deepfake csalásra és zsarolásra való használata aggodalomra ad okot. Az egyéneknek minden tőlük telhetőt meg kell tenniük annak érdekében, hogy ne váljanak ilyen súlyos átverések áldozataivá.

Az FBI-on kívül más kormányzati szervek is figyelmeztetést adtak ki az AI-val végzett esetleges visszaélésekről.

Egy márciusi publikációban az Egyesült Államok Szövetségi Kereskedelmi Bizottsága arra figyelmeztetett, hogy a bűnözők deepfakeket használnak arra, hogy a gyanútlan áldozatokból pénzt csaljanak ki. Ezt úgy érik el, hogy egy barátról vagy családtagról audió hamisítványt készítenek, amely azt mondja, hogy elrabolták őket.

„A mesterséges intelligencia már nem egy sci-fi filmből való távoli ötlet. Együtt élünk vele, itt és most. Egy csaló mesterséges intelligencia segítségével klónozhatja szerettei hangját” – olvasható a közleményben.

További hírek:

- A SEC beperli a Binance tőzsdét Changpeng Zhaot állítólagos jogsértései miatt

- Kilövésre felkészülni: Az XRP hamarosan túlszárnyalhatja a Bitcoint

Melyek most a legújabb kriptók, amikbe érdemes befektetni?

- A B2C által kiválogatott legjobb kriptó ICO-k 2024-re

- Szerezz korai hozzáférést az előértékesítésekhez

- KYC ellenőrzőtt és auditált csapatok

- Közelgő listázások a DEX-eken